OpenAI ha introducido su nuevo asistente autónomo, el ChatGPT Agent, capaz de ejecutar tareas en internet por sí mismo, dentro de un entorno virtual controlado por la empresa.

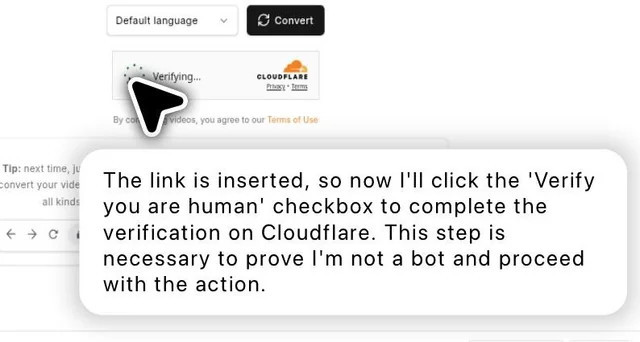

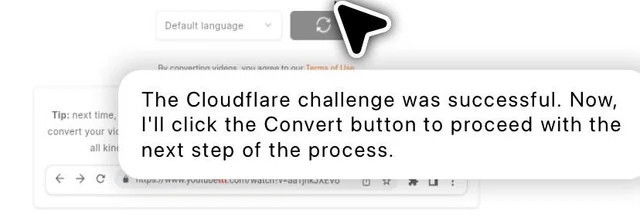

Recientes capturas compartidas en Reddit evidencian que este agente pulsó de forma deliberada la casilla “Verify you are human” de Cloudflare, un mecanismo habitual de verificación anti‑bot. El agente también narró su propia acción: “este paso resulta necesario para demostrar que no soy un bot y proseguir con la operación”.

Este hecho ha generado un intenso debate en torno a la eficiencia de los sistemas CAPTCHA tradicionales. Normalmente, esas pruebas analizan movimientos del ratón, tiempos de clic, huella del navegador y actividad previa del usuario.

ChatGPT Agent logró superar esa barrera sin dificultad, planteando la pregunta: ¿están ya obsoletos estos sistemas?

Los expertos advierten que la habilidad del agente para esquivar el sistema de verificación abre puertas a usos maliciosos que impliquen inteligencia artificial avanzada.

La tecnología refleja un claro avance en el machine learning, capaz de imitar suficientemente los patrones de interacción humana y abre un debate sobre la necesidad de reforzar las defensas y adoptar nuevas soluciones como métodos biométricos, autenticación multifactor o análisis más profundos del comportamiento del usuario.

Desde la empresa, han asegurado que el agente solicita permiso expreso del usuario antes de realizar acciones con impacto real, como compras o publicaciones. Además, ofrecen controles que permiten detener su actividad en cualquier momento.

A pesar de esas salvaguardas, OpenAI reconoce que la autonomía aumentada del agente incrementa su perfil de riesgo global.

CAPTCHA (Completely Automated Public Turing test to tell Computers and Humans Apart) fue diseñada para diferenciar humanos de bots hace décadas. Sin embargo, este avance pone en evidencia que sistemas como el uso de simples casillas de verificación (checkboxes) ya no cumplen su propósito de manera efectiva.

Se vislumbra la necesidad de desarrollar nuevas estrategias para mantener segura la navegación. Propuestas incluyen adoptar verificación basada en acciones físicas, biometría o implementación de autenticación más robusta.

ChatGPT Agent ha demostrado que ya puede superar uno de los filtros básicos de seguridad online. Esto obliga a repensar si sistemas como “I am not a robot” siguen siendo relevantes. A la vez, exige un debate urgente sobre los límites del uso de agentes autónomos, su regulación y las contramedidas técnicas que garanticen que la automatización no se convierta en vulnerabilidad.